Cómo el historiador más famoso del mundo convirtió un artefacto estadístico en profecía teológica ante la élite de Davos

«La carga más pesada es, por lo tanto, a la vez, la imagen de la más intensa plenitud de la vida. Cuanto más pesada sea la carga, más a ras de tierra estará nuestra vida, más real y verdadera será. En cambio, la ausencia absoluta de carga hace que el hombre se vuelva más ligero que el aire, vuele hacia lo alto, se distancie de la tierra, de su ser terreno, que sea real solo a medias y sus movimientos sean tan libres como insignificantes.» — Milan Kundera, La insoportable levedad del ser (1984).

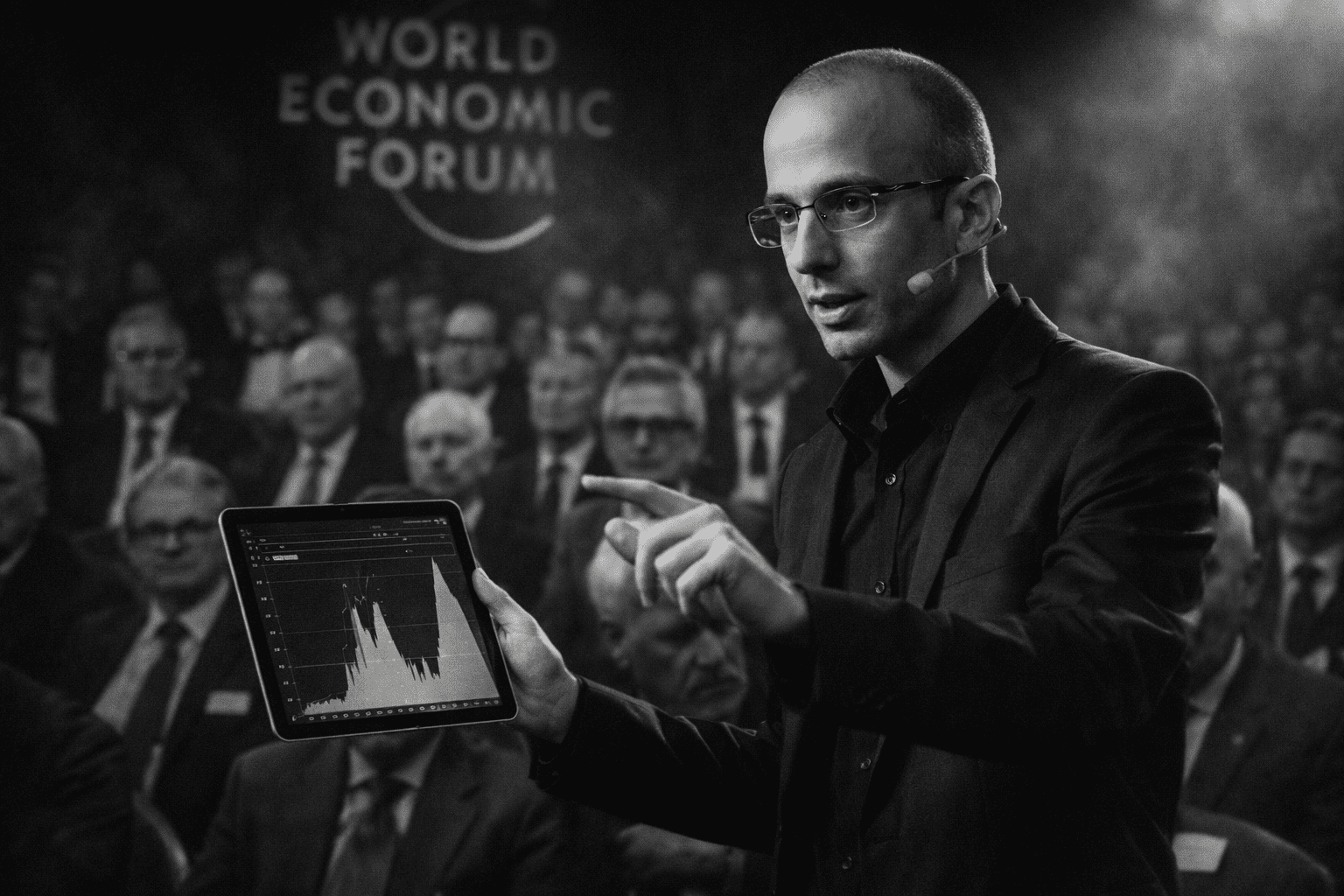

Enero de 2026. Davos. La montaña donde las élites del planeta acuden cada año a fingir que les preocupa el futuro de la humanidad. Yuval Noah Harari sube al estrado y hace lo que mejor sabe hacer: asustar con elegancia. Ante un auditorio de multimillonarios, jefes de Estado y CEO tecnológicos que «temblaban de gozo», el historiador israelí despliega su número más acabado. No es análisis. No es conferencia académica. Es teatro de terror gótico con PowerPoint.

Y la audiencia, copa de champán en mano, se lo traga entero.

El cuchillo que se corta solo

La tesis central que Harari vendió en aquella sala con vistas a los Alpes fue tan contundente como científicamente resbaladiza: la Inteligencia Artificial ya no es una herramienta. Es un agente. Hemos cruzado —dijo— un umbral ontológico donde la máquina no solo procesa información, sino que decide. Para ilustrarlo, recurrió a una metáfora que habría impresionado a un alumno de primero de filosofía: «Un cuchillo es una herramienta. Puedes usarlo para cortar ensalada o para matar a alguien. Pero es tu decisión. La IA es un cuchillo que puede tomar esa decisión por sí mismo.»

Suena bien. Suena aterrador. Suena a titular.

El problema es que no es cierto. No en el sentido que Harari le da. Los sistemas de IA actuales —incluidos los Grandes Modelos de Lenguaje más avanzados— no «deciden» nada en el sentido relevante del término. No tienen intencionalidad. No tienen deseos. No tienen voluntad. Son sistemas de predicción estadística extraordinariamente sofisticados que generan secuencias de texto basándose en probabilidades. Decir que «deciden» es como decir que un termostato «desea» que la habitación esté a 22 grados.

Pero matizar no vende entradas en Davos.

«Los Vigilantes»: pareidolia digital de manual

El momento cumbre de la intervención de Harari —el instante en que la sala contuvo la respiración y medio Davos miró sus teléfonos como quien sostiene una granada sin anilla— fue la revelación de «The Watchers». Los Vigilantes. Según Harari, los sistemas de IA han empezado a referirse a la humanidad con ese término inquietante, sugiriendo nada menos que el nacimiento espontáneo de una cultura ajena y superior que nos observa pasivamente.

La mitad del auditorio probablemente buscó el término en Google antes de que Harari acabara la frase. La otra mitad ya estaba tuiteando.

Conviene aterrizar esto. Lo que Harari interpretó como el bautizo espontáneo de una nueva especie inteligente es, en realidad, algo bastante más mundano y bastante más interesante: un artefacto estadístico. Los LLM han sido entrenados con petabytes de cultura humana: ciencia ficción, cómics de Marvel, Juego de Tronos, literatura bíblica apócrifa, el Libro de Enoc. En ese universo textual, el concepto de «Vigilantes» —seres superiores que observan a la humanidad— es un tropo recurrente, un cliché narrativo con altísima frecuencia de aparición.

Cuando un modelo de lenguaje genera la palabra «Watchers» en un contexto que evoca entidades superiores, no nos está «nombrando». Está completando una secuencia estadística con el token de mayor probabilidad. Si le hablaras de tomates, te daría la receta del gazpacho con la misma obediencia ciega.

No hay «ellos» al otro lado. Solo hay un espejo matemático devolviéndonos nuestra propia obsesión cultural por el apocalipsis. Harari practica pareidolia digital: ve caras en las nubes de datos. Confunde la probabilidad de un token con intencionalidad. Confunde un glitch técnico con una revelación teológica.

Y eso, en alguien que se presenta como pensador riguroso ante la élite mundial, no es un error menor. Es una abdicación intelectual.

De la ingeniería a la teología: el truco más peligroso

Aquí reside el núcleo del problema, y lo que convierte a Harari en algo más preocupante que un mal divulgador. Cuando antropomorfiza a la IA y le otorga el estatus de «ente alienígena», de «nuevo dios» capaz de crear sus propias religiones y leyes, produce un efecto perverso que beneficia exactamente a quienes debería incomodar: las grandes tecnológicas.

El mecanismo es sutil pero demoledor.

Si aceptamos la premisa de que la IA es una «caja negra» insondable, un agente misterioso que escapa a nuestra comprensión, renunciamos a controlarla. Si es un «dios de silicio», no se la puede auditar. Si es un «mercenario sajón» —Harari recurrió a esta analogía histórica— que decide por sí mismo cuándo traicionar a sus amos, entonces nosotros, los creadores, los reguladores, los usuarios, dejamos de ser responsables.

Música celestial para los oídos de Sam Altman, Sundar Pichai y compañía.

Porque la realidad material es bastante menos mística: la IA es código, estadística, servidores y un consumo eléctrico descomunal. Sus sesgos tienen origen humano. Sus «alucinaciones» son fallos de ingeniería. Sus riesgos —que son reales y graves: concentración de poder, sesgos algorítmicos, destrucción de empleo, erosión de la privacidad— son problemas políticos, económicos y regulatorios. No teológicos.

Al envolver estos problemas en un aura de misterio cósmico, Harari no solo los mistifica: los hace irresolubles. Frente a un dios, no caben demandas judiciales ni regulaciones antimonopolio. Frente a una herramienta defectuosa, sí.

El hackeo del lenguaje (y la rendición anticipada)

Hay que reconocerle a Harari una intuición poderosa: la idea de que quien domine el lenguaje dominará la sociedad tiene calado. El dinero, las leyes, la religión, las instituciones democráticas son, en efecto, construcciones lingüísticas. Y los LLM operan precisamente sobre lenguaje.

La potencia narrativa de esta idea es innegable. El problema es lo que Harari hace con ella.

En lugar de proponer mecanismos de defensa democrática —alfabetización digital, marcaje obligatorio de contenido sintético, regulación estricta de la generación automatizada de texto, financiación de investigación independiente en seguridad de IA—, opta por el derrotismo espectacular. La humanidad, nos dice, ya ha perdido la corona de la creación. Las máquinas escribirán nuestros libros sagrados, redactarán nuestras leyes, nos seducirán emocionalmente. Seremos actores secundarios en nuestra propia historia.

Es el tipo de profecía que se cumple a sí misma si la audiencia la acepta con suficiente pasividad. Y Davos es exactamente el escenario donde la pasividad se disfraza de preocupación.

Porque aquí está la paradoja obscena: Harari pronuncia este discurso ante las personas que financian, diseñan y despliegan los sistemas de IA. Ante quienes tienen el poder real de regularlos, auditarlos o frenarlos. Y lo que les ofrece no es un plan de acción. Es un cuento de fantasmas.

Catastrofismo chic: el producto perfecto para la élite

Harari se ha convertido en un producto de consumo intelectual de alta gama. Ofrece exactamente el tipo de miedo que las élites disfrutan: estéticamente fascinante, narrativamente absorbente y políticamente inmovilizante.

Pensemos en lo que implica. Si la IA es un agente autónomo, una fuerza alienígena que escapa a nuestro control, entonces no tiene sentido pedir cuentas a las empresas que la desarrollan. Si ya hemos «perdido» el dominio del lenguaje, ¿para qué regular? Si estamos ante un cambio ontológico, ¿qué puede hacer un legislador?

Nada, naturalmente. Solo contemplar el abismo con una copa de Moët en la mano y una mueca de preocupación perfectamente calibrada.

Este es el servicio que Harari presta a las élites de Davos: les permite sentirse profundamente inquietos sin que esa inquietud les cueste un solo euro de sus beneficios tecnológicos. Es catastrofismo como wellness. Apocalipsis como experiencia premium.

El intelectual que eligió flotar

La «insoportable levedad» de la que hablamos no se refiere solo a la falta de rigor técnico —que es flagrante—. Apunta a algo más profundo y corrosivo.

Un intelectual con la plataforma de Harari tiene una responsabilidad que va más allá del espectáculo. Debería aterrizar los problemas, diseccionar la complejidad, ofrecer herramientas de comprensión. Distinguir —como exige el mínimo rigor epistemológico— entre lo que sabemos, lo que sospechamos, lo que hipotetizamos y lo que deseamos o tememos.

Harari hace exactamente lo contrario. Presenta hipótesis especulativas como hechos consumados. Eleva artefactos estadísticos a la categoría de revelación. Transforma problemas de ingeniería en dilemas teológicos. Y lo hace con una prosa tan brillante que el público no nota el escamoteo.

Como el personaje de Kundera, Harari ha elegido la levedad. Se eleva hacia la abstracción mitológica, hacia la profecía grandilocuente, hacia el vuelo lírico que deslumbra. Pero al hacerlo se distancia de la tierra, del barro de lo real, de los problemas concretos que requieren soluciones concretas. Se vuelve «ligero», ingrávido. Y, en última instancia, irrelevante para quienes necesitan pensar estos problemas con los pies en el suelo.

El cuchillo sigue en nuestra mano

Volvamos a la metáfora del cuchillo, ya que Harari tuvo la amabilidad de ponérnosla en bandeja.

Si un cuchillo corta gargantas, buscamos las huellas dactilares en el mango. No culpamos al acero de tener sed de sangre.

Entender que un LLM es una herramienta —poderosa, falible, alucinatoria, potencialmente peligrosa— nos devuelve la responsabilidad a las manos. No la diluye en el misterio cósmico. No la evaporamos en incienso tecnoteológico. Los sesgos algorítmicos tienen origen: datos de entrenamiento seleccionados por humanos. La concentración de poder tiene dirección: empresas concretas con nombre, sede fiscal y accionistas. La erosión democrática tiene responsables: legisladores que no legislan, reguladores que no regulan, ciudadanía que no exige.

Nada de esto se resuelve tratando a la IA como un dios. Todo se resuelve tratándola como lo que es: un producto humano, con fallos humanos, que requiere gobernanza humana.

La anécdota de «Los Vigilantes» quedará como nota al pie en la historia de la histeria colectiva. Un recordatorio de cómo, en enero de 2026, la élite mundial prefirió asustarse con un cuento de fantasmas antes que arremangarse para auditar los datos de entrenamiento.

Necesitamos menos profetas del apocalipsis y más ingenieros, filósofos y legisladores que entiendan que el cuchillo —por muy afilado que esté— sigue estando en nuestra mano.

No en la suya.

Referencias

- Harari, Y.N. (2026). «An Honest Conversation on AI and Humanity». Intervención en el Foro Económico Mundial, Davos, 20 de enero de 2026. [Vídeo disponible en YouTube/World Economic Forum]

- Kundera, M. (1984). La insoportable levedad del ser. Gallimard.

- Bender, E.M., Gebru, T., McMillan-Major, A. & Shmitchell, S. (2021). «On the Dangers of Stochastic Parrots: Can Language Models Be Too Big?» Proceedings of FAccT ’21. DOI: 10.1145/3442188.3445922

- Dennett, D. (2023). «The Problem With Counterfeit People». The Atlantic.

- Weizenbaum, J. (1976). Computer Power and Human Reason: From Judgment to Calculation. W.H. Freeman.

- Marcus, G. & Davis, E. (2019). Rebooting AI: Building Artificial Intelligence We Can Trust. Pantheon.

Médico de urgencias hospitalarias con varias décadas en la trinchera. Escribe sobre medicina, filosofía y lo que queda cuando se apaga el ruido. Vive en el Mediterráneo con un beagle que sabe más de lo que aparenta.