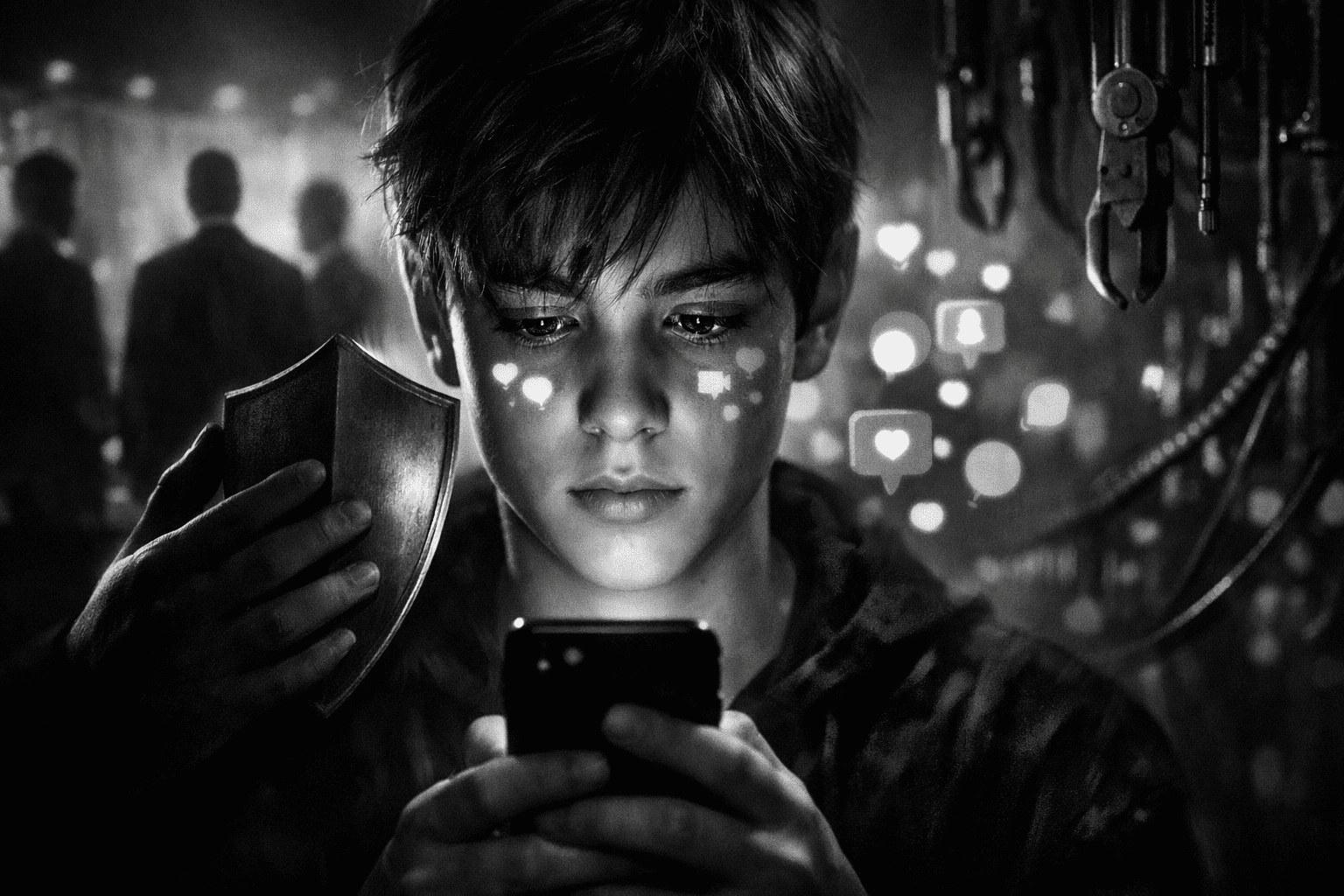

Australia prohíbe, España legisla, pero las corporaciones siguen diseñando para enganchar. La batalla por proteger a los adolescentes del daño digital requiere más que leyes: exige responsabilizar a quien fabrica la adicción.

El 10 de diciembre de 2025, Australia escribió un capítulo inédito en la regulación digital: ningún menor de 16 años puede acceder legalmente a redes sociales como Instagram, TikTok, Snapchat o X. Las plataformas que incumplan enfrentan multas de hasta 32 millones de dólares. Unos días después, Pedro Sánchez anunciaba que España seguiría un camino similar, aunque con matices: consentimiento parental obligatorio entre los 14 y 16 años, sistemas de control parental preinstalados en dispositivos, y verificación de edad para el tratamiento de datos personales.

Dos países, dos aproximaciones. Pero ambas responden a la misma pregunta incómoda: ¿por qué necesitamos prohibir o restringir severamente algo que las corporaciones tecnológicas diseñaron específicamente para ser irresistible?

La respuesta no está en la psicología adolescente. Está en las salas de ingeniería de Silicon Valley, donde equipos enteros trabajan para hackear nuestros cerebros. Y esa es la hipótesis que deberíamos discutir con más claridad: las grandes corporaciones tecnológicas son, en gran medida, responsables de una crisis de salud mental en adolescentes porque diseñaron productos que maximizan el tiempo de uso sin importar las consecuencias. Las administraciones públicas, entonces, no están regulando un problema espontáneo. Están respondiendo a un daño manufacturado.

El mecanismo al desnudo: arquitectura de la adicción

Cuando abres Instagram, TikTok o cualquier red social, no estás usando una herramienta neutral. Estás entrando en un entorno diseñado con precisión algorítmica para mantenerte allí el máximo tiempo posible. Y no es casualidad: es ingeniería.

El scroll infinito elimina puntos naturales de parada. Antes, terminabas una revista. Ahora, nunca terminas de ver contenido porque siempre hay más. El autoplay arranca el siguiente vídeo antes de que decidas si quieres verlo. Las notificaciones push te interrumpen con la frecuencia exacta para maximizar tu regreso sin molestarte tanto como para que las desactives. Los “me gusta” y comentarios activan el sistema de recompensas del cerebro, liberando dopamina como lo haría una máquina tragaperras.

Tristan Harris, exempleado de Google y fundador del Center for Humane Technology, lo llamó “la carrera hacia el fondo del tronco cerebral”. Las empresas compiten por quién puede explotar mejor nuestras vulnerabilidades cognitivas. Y los adolescentes, con cerebros aún en desarrollo y sistemas de recompensa hipersensibles, son especialmente vulnerables.

La evidencia es robusta. Estudios longitudinales muestran asociaciones entre uso intensivo de redes sociales y ansiedad, depresión, trastornos del sueño, y problemas de imagen corporal. Meta (Facebook/Instagram) tiene sus propios estudios internos que lo confirman. En 2021 se filtró un documento que reconocía que “Instagram empeora los problemas de imagen corporal en una de cada tres adolescentes”. Entre adolescentes con ideación suicida, el 6% en EE.UU. atribuía esos pensamientos a Instagram.

¿La respuesta de Meta? Seguir optimizando para engagement. Porque el modelo de negocio no se basa en tu bienestar, sino en tu tiempo de pantalla. Cada segundo que pasas scrolling es un segundo en el que pueden mostrarte publicidad. Tu atención no es el producto. Tú eres el producto.

Ejemplos documentados: cuando la ingeniería se convierte en daño

En 2020, el documental The Social Dilemma reveló testimonios de exingenieros de Silicon Valley sobre cómo diseñaron estos sistemas. Aza Raskin, creador del scroll infinito, expresó su arrepentimiento: “Es como si le diéramos cocaína a los niños pero en forma de píxeles”. Las empresas lo sabían. Y no cambiaron el diseño porque cambiar reduciría ingresos.

TikTok es quizá el caso más refinado. Su algoritmo es tan preciso que la gente bromea sobre “TikTok me conoce mejor que mi terapeuta”. Pero esa precisión significa que sabe exactamente qué tipo de contenido te mantiene enganchado, aunque ese contenido sea dañino. El algoritmo no distingue entre “engagement porque te divierte” y “engagement porque te genera ansiedad”.

YouTube anunció este año que usaría IA para detectar la edad de usuarios en Australia y otros países. ¿La respuesta de la gente? Protestas por privacidad. Las corporaciones han creado un dilema perverso: para protegernos de sus sistemas, necesitamos darles aún más datos personales.

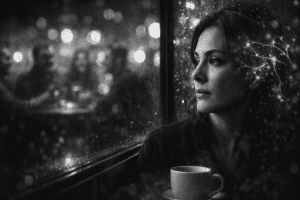

Por qué caemos: no es debilidad, es arquitectura cerebral

Es tentador pensar que los adolescentes adictos a redes sociales “simplemente deberían autocontrolarse”. Pero esa narrativa ignora cómo funcionan los cerebros adolescentes y cómo están diseñadas las plataformas.

Durante la adolescencia, el sistema de recompensas (núcleo accumbens) está hipersensible. La corteza prefrontal, que regula impulsos y toma de decisiones a largo plazo, aún no ha madurado completamente. Esto no es defecto. Es evolución. Los adolescentes deben ser más curiosos, más propensos a explorar, más sensibles a la validación social. En un entorno natural, eso era adaptativo.

Pero las redes sociales explotan precisamente esas vulnerabilidades. No estás luchando contra una debilidad personal. Estás luchando contra equipos de ingenieros con doctorados en neurociencia y psicología conductual, respaldados por presupuestos millonarios y pruebas A/B con millones de usuarios.

Y funciona incluso en gente informada. Profesionales de salud mental que estudian adicción digital también caen. Porque el diseño está optimizado para nuestras vulnerabilidades compartidas como especie, no para nuestra fuerza de voluntad individual.

Australia vs España: dos modelos, misma pregunta

El modelo australiano es el más restrictivo del mundo. Prohibición total para menores de 16 años, sin excepciones, ni siquiera con permiso parental. Las plataformas son responsables de verificar edad, bloquear acceso, y eliminar cuentas de menores. Multas millonarias por incumplimiento. El mensaje es claro: los menores no deberían estar aquí, punto.

Críticas al modelo australiano:

- Libertad de expresión: Dos adolescentes ya demandaron alegando que viola su derecho a participación política.

- Privacidad: Verificación de edad requiere datos biométricos o documentos de identidad para todos los usuarios, no solo menores.

- Migración a espacios más peligrosos: Los adolescentes podrían refugiarse en la deep web, Discord, o plataformas no reguladas.

- Falsa sensación de seguridad: Muchos contenidos dañinos (páginas de citas, videojuegos con loot boxes, chatbots de IA) quedan fuera de la regulación.

- Eficacia dudosa: VPNs permiten eludir bloqueos fácilmente.

El modelo español (aún en tramitación parlamentaria) es más gradual. Eleva la edad de consentimiento para tratamiento de datos personales de 14 a 16 años. Los menores entre 14 y 16 años pueden usar redes sociales con autorización parental explícita. Se obliga a fabricantes de dispositivos a incluir controles parentales gratuitos activados por defecto. Se crea una Estrategia Nacional de Protección de la Infancia en Entornos Digitales. Se penalizan las deepfakes sexuales y el grooming con mayor dureza.

Críticas al modelo español:

- Supervisión parental no universal: Asume que todos los padres tienen tiempo, competencia digital, y voluntad de supervisar. En muchas familias no es así.

- Carga sobre familias: Traslada responsabilidad de corporaciones a padres sin recursos comparables.

- Verificación de edad imperfecta: Los sistemas actuales son o invasivos (biometría) o fáciles de burlar (autodeclaración).

La pregunta que ambos modelos eluden

Aquí está el problema de fondo: ninguno de estos modelos obliga a las corporaciones a cambiar el diseño que genera el daño.

Australia prohíbe el acceso. España exige consentimiento parental. Pero ambas estrategias asumen que el producto en sí es aceptable si se restringe su uso. Es como si ante una epidemia de intoxicaciones por un alimento adulterado, la solución fuera prohibir que los niños lo coman en lugar de obligar al fabricante a dejar de adulterarlo.

¿Por qué no exigir a Meta, TikTok, Snapchat que eliminen el scroll infinito, el autoplay, las notificaciones manipuladoras, los algoritmos de máxima adicción? ¿Por qué no regular el diseño mismo en lugar de solo el acceso?

La respuesta es política y económica. Estas corporaciones tienen un poder inmenso. Lobby, recursos legales ilimitados, amenazas de retirada de servicios. Pero sobre todo, han logrado construir una narrativa donde la responsabilidad es individual: “los padres deben supervisar”, “los usuarios deben autocontrolarse”, “la educación digital es clave”. Todo eso es cierto, pero insuficiente. Es como culpar a los fumadores de cáncer de pulmón mientras las tabacaleras añaden nicotina para maximizar adicción.

Herramientas de resistencia: más allá de prohibir

Si asumimos que las corporaciones no cambiarán voluntariamente (porque su modelo de negocio depende de engancharnos), ¿qué podemos hacer?

1. Regulación del diseño, no solo del acceso Prohibir prácticas específicas: scroll infinito en apps para menores, autoplay sin opt-in activo, notificaciones ilimitadas. La UE está explorando esto con la Digital Services Act, pero necesita más dientes.

2. Transparencia algorítmica obligatoria Que las plataformas publiquen cómo funcionan sus algoritmos de recomendación. No el código fuente (secreto comercial legítimo), pero sí los criterios: ¿maximizan tiempo de pantalla? ¿priorizan contenido polémico porque genera más engagement? Los usuarios tienen derecho a saberlo.

3. Modelos de negocio alternativos Actualmente, las redes sociales son “gratuitas” porque el producto somos nosotros. ¿Y si fueran servicios de suscripción sin publicidad? Menos usuarios, pero modelo de negocio alineado con bienestar del usuario, no con su adicción. Esto requeriría incentivos regulatorios o fiscales.

4. Alfabetización digital profunda No solo “cuidado con extraños online”. Enseñar cómo funcionan los algoritmos, qué es el diseño persuasivo, cómo detectar manipulación. Desde primaria. No es suficiente por sí solo, pero es necesario.

5. Responsabilidad civil de las plataformas Si se demuestra que el diseño de una plataforma causó daño psicológico a menores de forma sistemática, debería haber vías legales de compensación. Como las demandas contra tabacaleras. Esto ya está empezando en EE.UU.

6. Apoyo público a redes descentralizadas Financiar alternativas como Mastodon, que no dependen de publicidad y no están diseñadas para maximizar adicción. No sustituirán a Instagram mañana, pero crean presión competitiva.

Australia ha iniciado un experimento global

La prohibición australiana lleva activa poco más de dos meses. Es demasiado pronto para resultados definitivos. Pero todos los ojos están puestos en qué ocurre:

- ¿Los adolescentes migran masivamente a VPNs y plataformas no reguladas?

- ¿Se reduce efectivamente el tiempo de pantalla y mejoran indicadores de salud mental?

- ¿Las plataformas cumplen o buscan vacíos legales?

- ¿Los padres reportan mejor comunicación con sus hijos o más conflictos?

- ¿Qué efectos tiene en adolescentes rurales, LGTBI+, o con discapacidades que dependían de redes para conexión social?

España, si aprueba su ley, añadirá otra variante al experimento. Y otros países (Francia, Portugal, Italia, Reino Unido con su Online Safety Act) están en puntos intermedios.

Pero mientras esperamos datos, no perdamos de vista la hipótesis central: el problema no es que los adolescentes sean débiles. El problema es que ingenieros altamente pagados diseñaron sistemas para explotar debilidades humanas universales, y luego esos sistemas se desplegaron sin restricciones en poblaciones vulnerables.

Reclamar responsabilidad corporativa, no solo control parental

Si un fabricante de juguetes vendiera productos con plomo que envenenaran a niños, nadie diría “los padres deberían supervisar mejor”. Exigiríamos que el fabricante dejara de poner plomo en los juguetes. ¿Por qué con las redes sociales aceptamos un estándar diferente?

Las corporaciones tecnológicas han invertido décadas y miles de millones en perfeccionar sistemas de engagement. Han contratado a los mejores neurocientíficos, psicólogos, diseñadores de experiencia de usuario. Han probado millones de variaciones algorítmicas para maximizar adicción. Y luego presentan el resultado como “una herramienta neutral que puedes usar como quieras”. Es deshonesto intelectualmente y éticamente obsceno.

Australia y España están intentando soluciones imperfectas a un problema real. Pero la solución definitiva no vendrá de prohibir el acceso. Vendrá de prohibir el diseño manipulador. De multar a las corporaciones que optimizan para adicción. De exigir transparencia sobre cómo funcionan los algoritmos que determinan qué ven nuestros hijos.

Y de dejar de culpabilizar a familias individuales por no poder competir contra corporaciones con presupuestos de miles de millones diseñados explícitamente para vencer cualquier resistencia humana razonable.

Referencias

- Andreassen, C. S., et al. (2016). The relationship between addictive use of social media and video games and symptoms of psychiatric disorders. Comprehensive Psychiatry.

- Logatt Grabner, C. Y., & Parra Bolaños, N. (2025). Adicción a las redes sociales, marketing digital y diseño algorítmico. Lexenlace: Revista Latinoamericana de Ciencias Sociales, 2(2), 132-139.

- Primack, B. A., et al. (2017). Use of multiple social media platforms and symptoms of depression and anxiety. Computers in Human Behavior.

- Documentación sobre legislación australiana: Online Safety (Social Media Minimum Age) Bill 2024

- Proyecto de Ley Orgánica para la protección de las personas menores de edad en los entornos digitales (España, 2025)

- Estudios internos de Meta filtrados sobre impacto de Instagram en adolescentes (2021)

NOTA EDITORIAL: Este artículo forma parte de la cobertura de RedBeta sobre cómo las grandes corporaciones tecnológicas explotan vulnerabilidades cognitivas para maximizar beneficios. Para más análisis sobre Ilustración Oscura y tecnoutopismo reaccionario, consulta nuestra sección ÁGORA.

Médico de urgencias hospitalarias con varias décadas en la trinchera. Escribe sobre medicina, filosofía y lo que queda cuando se apaga el ruido. Vive en el Mediterráneo con un beagle que sabe más de lo que aparenta.