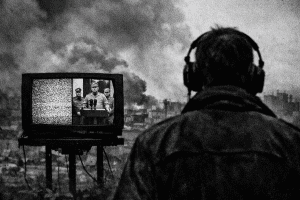

Cuando Tesh Sidi recibió miles de amenazas de muerte, las plataformas no fallaron. Funcionaron exactamente como estaban diseñadas.

El 12 de febrero de 2026, la diputada Tesh Sidi —primera mujer saharaui en el Congreso de los Diputados, integrante del grupo Sumar— publicó un meme irónico en Instagram sobre quienes rechazan la regularización de migrantes. Lo que vino después fue una lección sobre cómo funciona realmente el capitalismo de plataformas.

En cuestión de horas, miles de mensajes. No de bots. De personas con cuentas verificadas, con nombre y apellidos. Mensajes como “Te estamos buscando y vas a llegar en caja de pino al Sáhara”, “Acabarás siendo fusilada”, “3 tiros y a un pozo”, “Te vamos a mandar a trocitos a Marruecos”. Más de 2.000 perfiles que, según la denuncia formalizada ante la Comisaría del Congreso, habrían incurrido en presuntos delitos de amenazas y odio. El componente racista era explícito, sistemático, sin disimulo. La diputada describió que los ataques se coordinaron desde canales de Telegram de extrema derecha, que remitieron el contenido a sus redes de manera organizada.

Sidi lo resumió con una frase que debería grabarse en los despachos de Meta, TikTok, YouTube y X: “Tú amenazas de muerte a alguien y la policía se planta en tu casa. Pero en el espacio digital, la policía necesita que Instagram, que TikTok coopere y no lo hacen.”

Tenía razón. Y el problema no es técnico. Es económico.

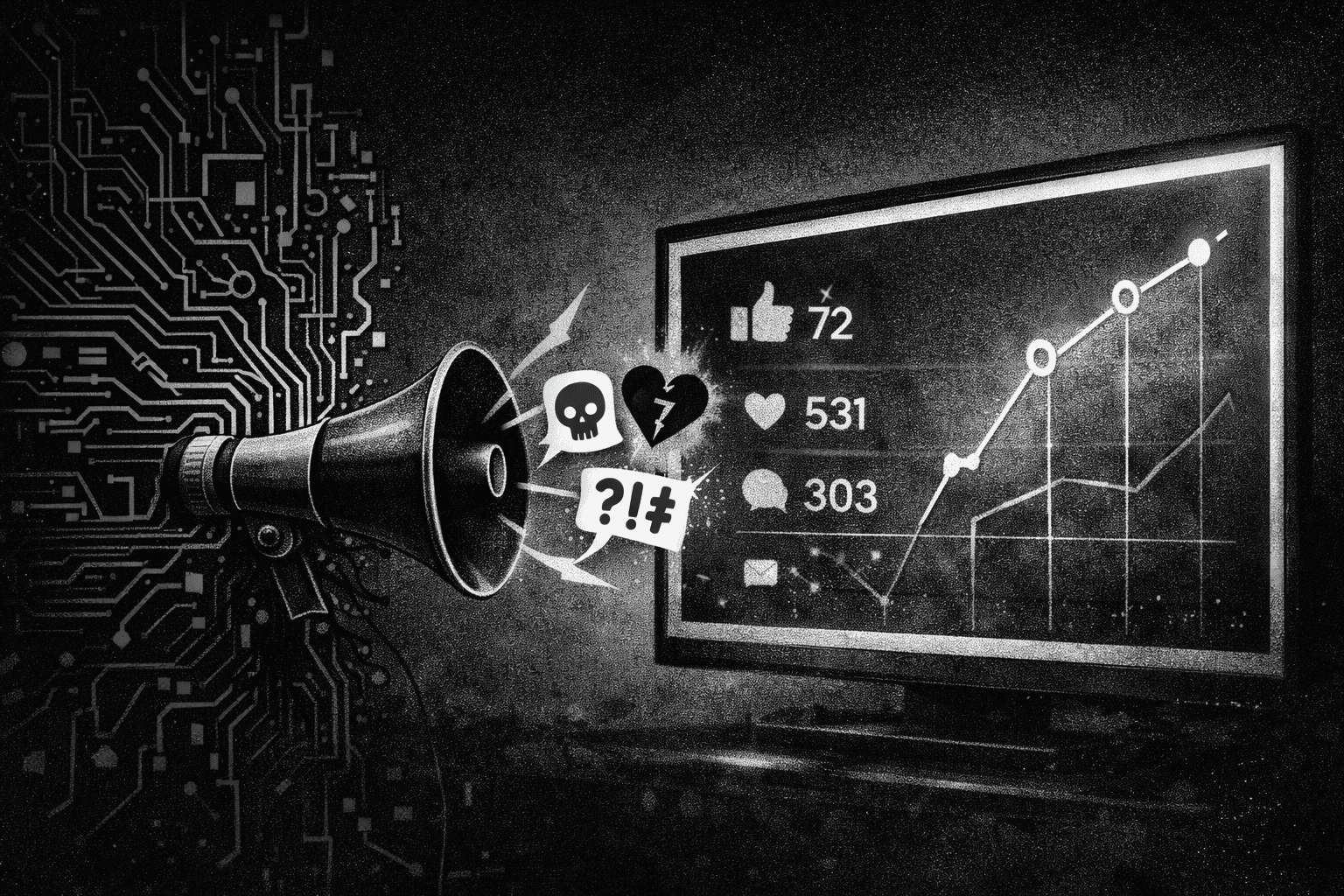

El algoritmo no tiene ideología: tiene métricas

Conviene despejar primero un malentendido cómodo. Las plataformas no amplifican el odio porque tengan simpatías por la ultraderecha o porque sus ingenieros sean perversos. Lo amplifican porque el odio genera engagement, y el engagement genera publicidad, y la publicidad es la única razón por la que estas empresas existen.

El mecanismo es conocido desde que en 2021 The Wall Street Journal publicó documentos internos de Facebook que lo dejaban por escrito sin ambages: el propio algoritmo de la compañía, según sus investigadores internos, “explota la atracción del cerebro humano por la división” porque los contenidos divisivos generan más interacción. La empresa sabía. Lo dejó en un documento. Y siguió adelante.

La lógica es la misma en todas las plataformas. Un estudio de Mozilla Foundation detectó que más del 70% de los vídeos visualizados en YouTube provienen de recomendaciones algorítmicas que premian la polarización. Investigadores de la Universidad de Nueva York documentaron que en X —la antigua Twitter, bajo la gestión de Elon Musk convertida en acelerador oficial del discurso de odio— los mensajes con carga emocional negativa se difunden más rápido y alcanzan mayor viralidad que los neutrales. Y el mercado global de publicidad digital alcanzó en 2025 los 690.000 millones de dólares. Para poner esa cifra en perspectiva: supera el Producto Interior Bruto de Suiza o Turquía. Es un flujo de dinero que no existía hace veinte años y que hoy sostiene a las empresas más valiosas del planeta.

El odio no es un bug. Es una característica del producto.

Por qué caemos: la arquitectura de la indignación

Aquí se impone ser precisos. No es que los usuarios de redes sociales sean estúpidos o especialmente maldadosos. Es que las plataformas han construido entornos diseñados para explotar vulnerabilidades cognitivas específicas, documentadas y conocidas.

El sesgo de disponibilidad nos hace sobrevalorar lo que es emocionalmente intenso y reciente. Los algoritmos aprenden a servir exactamente eso. El pensamiento de grupo nos hace más agresivos cuando percibimos que actuamos dentro de una tribu. Las campañas organizadas desde Telegram —como la que sufrió Sidi— reproducen artificialmente esa sensación de tribu, de que “muchos” comparten la indignación. El efecto de desinhibición online, estudiado extensamente desde los años noventa, muestra que las personas dicen y hacen en entornos digitales lo que jamás harían cara a cara. No porque sean hipócritas, sino porque el contexto físico activa inhibidores morales que la pantalla desconecta.

Lo que Sidi recibió no fue un estallido espontáneo de odio popular. Fue odio organizado, amplificado algorítmicamente y monetizado en tiempo real.

Cada comentario que respondía a las amenazas generaba interacción. Cada interacción le indicaba al algoritmo que ese contenido era “relevante”. Cada indicación de relevancia lo distribuía a más usuarios. El algoritmo no distingue entre indignación moral y amenaza de muerte: mide tiempo de permanencia, clics, respuestas. Y mientras Tesh Sidi leía “te vamos a mandar a trocitos a Marruecos”, alguien en California —o en Menlo Park— estaba viendo subir los números de engagement en su dashboard.

Las plataformas lo saben. Y tienen un DSA que cumplir a medias.

Que las plataformas carecen de herramientas técnicas para detectar amenazas es una mentira que sólo se sostiene si no se piensa más de diez segundos. La propia Sidi lo formuló con la precisión de alguien que lleva semanas estudiando el problema: “No me creo que Meta no tenga mecanismos de diccionario ni algoritmos capaces de unir palabras y detectar estos mensajes.”

Tiene razón. Las mismas empresas que son capaces de predecir con exactitud estadística si una persona está considerando comprar un coche basándose en sus patrones de scroll, son capaces de detectar combinaciones de palabras que forman amenazas de muerte. No lo hacen sistemáticamente porque moderarlo cuesta dinero y amplificarlo genera dinero.

La Unión Europea aprobó en 2022 el Reglamento de Servicios Digitales —DSA, por sus siglas en inglés— que entró en plena aplicación en febrero de 2024. Es, en teoría, la regulación más ambiciosa del mundo en este ámbito. Las plataformas con más de 45 millones de usuarios activos en la UE —Meta, TikTok, YouTube, X— tienen obligaciones específicas: evaluar y mitigar riesgos sistémicos, incluyendo violencia digital y discurso de odio; publicar informes de transparencia sobre moderación de contenidos; someterse a auditorías externas; permitir acceso a datos a investigadores.

En diciembre de 2025, la Comisión Europea impuso a X una multa de 120 millones de euros por incumplimientos del DSA. En noviembre de 2025 había 14 investigaciones abiertas contra plataformas muy grandes, incluyendo Facebook e Instagram. Los datos disponibles son reveladores: en el primer semestre de 2025, el 99% de las decisiones de moderación de contenido las tomaban las propias plataformas para hacer cumplir sus términos y condiciones, no para retirar contenido notificado como ilegal conforme a legislación europea o nacional. Es decir: las plataformas moderan lo que ellas mismas consideran que viola sus reglas, no necesariamente lo que viola la ley.

El DSA es un avance real. Es también, en su estado actual de aplicación, insuficiente frente a la velocidad y escala del problema.

El steel man de las plataformas: no todo es tan simple

Sería deshonesto no considerar los argumentos de la parte contraria en su versión más sólida.

Las plataformas pueden argüir —y argumentan— que la moderación a escala masiva es extraordinariamente difícil. Con miles de millones de publicaciones diarias en múltiples idiomas, culturas y contextos, los sistemas automatizados cometen errores en ambas direcciones: eliminan contenido legítimo (censura) y dejan pasar contenido dañino (permisividad). Desde la aplicación del DSA, el 30% de las 165 millones de decisiones de moderación que los usuarios impugnaron a través de los mecanismos internos de las plataformas fueron revertidas. Eso sugiere que la moderación es genuinamente imperfecta, no sólo maliciosa.

El argumento de la libertad de expresión tiene también sustancia real: definir qué es amenaza y qué es hipérbole, qué es discurso de odio y qué es crítica agresiva legítima, no es tarea trivial. Distintas culturas, distintos contextos legales, distintas tradiciones retóricas.

Todo esto es cierto. Y no cambia el análisis de fondo.

Que la moderación sea difícil no explica por qué el algoritmo amplifica activamente el contenido que genera indignación. Que existan errores en ambas direcciones no explica por qué el modelo de negocio incentiva estructuralmente la polarización. Que la libertad de expresión sea un valor no explica por qué “Te vamos a mandar a trocitos a Marruecos” cae dentro de ella según los criterios operativos de las plataformas.

La dificultad técnica no es excusa cuando el incentivo económico apunta en dirección contraria a la solución.

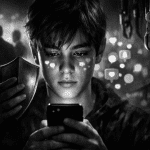

Lo que está en juego: quién puede hablar en el espacio público

El caso de Tesh Sidi no es solo el caso de Tesh Sidi. Es el patrón documentado de lo que ocurre cuando una mujer racializada, o una periodista, o una activista, o cualquier persona que representa una identidad que ciertos sectores consideran “invasora”, decide participar en el debate público digital.

La propia diputada lo describió con claridad después de las denuncias: el acoso no cesó, cambió de forma. “Ya no es tanto el ‘te voy a matar’, ahora es más racismo”, relató. Las amenazas directas se desplazaron hacia una modalidad más sutil pero igualmente eficaz: el desgaste por acoso permanente, diseñado para que las personas se autocensuren, reduzcan su presencia pública, abandonen el campo.

“Estar en la institución como mujer ya es un acto de resistencia”, dijo Sidi. Y tenía razón, aunque esa frase describe una distopía, no una virtud.

Cuando las plataformas permiten que el odio organizado funcione como herramienta de exclusión sistemática de ciertos perfiles del debate público, no están siendo neutrales. Están tomando partido. El espacio digital no es equitativo: favorece a quienes pueden generar más indignación, a quienes tienen más redes de amplificación, a quienes disponen de más canales organizados de distribución del odio. Las ultraderechas europeas llevan años perfeccionando exactamente eso.

Una regulación que no puede llegar tarde

La respuesta no puede limitarse a que cada persona amenazada denuncie individualmente a 2.000 usuarios. Eso es judicializar el síntoma mientras la enfermedad crece.

Lo que hace falta es un marco que obligue a las plataformas a internalizar el coste de los daños que externalizan. Que la amplificación algorítmica de contenidos que forman parte de campañas coordinadas de acoso tenga consecuencias económicas proporcionales. Que la cooperación con autoridades judiciales no sea discrecional. Que los algoritmos de recomendación sean auditables externamente.

El DSA europeo apunta en esa dirección. La resistencia de la administración Trump —que ha llegado a calificar la regulación como “censura de discurso americano”— no hace sino confirmar qué intereses defiende. Porque lo que está en juego no es la libertad de expresión. Es la libertad de algunos para silenciar a otros usando el dinero de todos como combustible.

Mientras Tesh Sidi leía amenazas de muerte, las acciones de Meta cotizaban a máximos históricos.

El odio no es un error del sistema. Es el sistema funcionando a pleno rendimiento.

Referencias

Europa Press (2026, 13 de febrero). “La diputada Tesh Sidi denuncia ante la Policía multitud de amenazas de muerte y mensajes de odio contra ella en redes.” Recogido por Infobae, El Diario, Democrata.es.

Sidi, Tesh [@teshsidi] (2026, 12 de febrero). Publicaciones en X (Twitter) sobre las amenazas recibidas y la denuncia ante la Policía Nacional. Recogido en La Voz del Sur (entrevista posterior).

Wall Street Journal (2021). “Facebook Knows Instagram Is Toxic for Teen Girls, Company Documents Show.” Documentos internos sobre algoritmos de Facebook. Recopilado en múltiples fuentes secundarias.

Mozilla Foundation (s.f.). Estudio sobre el sistema de recomendaciones de YouTube y polarización. Citado en Diario Red (2026, 26 de febrero). “El rentable negocio del odio en las redes sociales.”

Consejo de la Unión Europea (2022). Digital Services Act — Reglamento (UE) 2022/2065. Aplicación desde el 17 de febrero de 2024. https://www.consilium.europa.eu/en/policies/digital-services-act/

Comisión Europea (2025). “Two years of Digital Services Act allows 50 million content moderation decisions to be reversed.” Digital Strategy EU. https://digital-strategy.ec.europa.eu/en/news/two-years-digital-services-act-allows-50-million-content-moderation-decisions-platforms-be-reversed

Wikipedia (actualizado a noviembre 2025). “Digital Services Act.” Incluye multa a X de 120 millones de euros (diciembre 2025) e investigaciones en curso. https://en.wikipedia.org/wiki/Digital_Services_Act

Observatorio Español del Racismo y la Xenofobia — Ministerio de Inclusión (s.f.). “Novedades en la aplicación de la Ley de Servicios Digitales (DSA) para garantizar la transparencia de las plataformas.” https://www.inclusion.gob.es

Médico de urgencias hospitalarias con varias décadas en la trinchera. Escribe sobre medicina, filosofía y lo que queda cuando se apaga el ruido. Vive en el Mediterráneo con un beagle que sabe más de lo que aparenta.